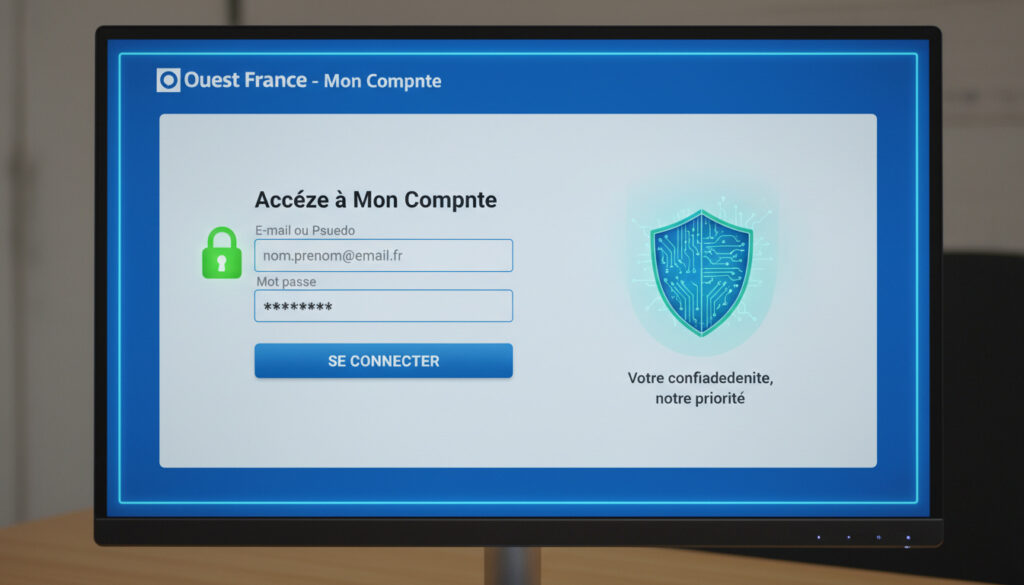

Ouest France Mon Compte – Accès Sécurisé et Mots-Clés Masqués

L’accès à l’espace personnel « Mon Compte » du groupe Ouest-France s’inscrit dans un écosystème numérique où la protection des données de recherche et la confidentialité des parcours utilisateurs posent des défis techniques spécifiques. Les abonnés du quotidien régional rencontrent fréquemment des difficultés pour localiser certaines fonctionnalités ou comprendre pourquoi leurs requêtes d’accès apparaissent anonymisées dans les statistiques de fréquentation.

Le phénomène des mots-clés « not provided » dans Google Analytics concerne directement ces tentatives de connexion. Lorsqu’un internaute recherche ouest france mon compte depuis un moteur de recherche sécurisé, le terme exact utilisé disparaît des rapports analytiques classiques, remplacé par une mention cryptique qui complexifie l’analyse des besoins réels des lecteurs.

Cette situation résulte des politiques de protection de la vie privée mises en place par les navigateurs majeurs, notamment via l’adoption généralisée du protocole HTTPS. Comprendre ces mécanismes permet mieux appréhender les limites des données disponibles pour optimiser l’expérience des abonnés numériques et les alternatives existantes.

Comment accéder à son compte Ouest-France et gérer son abonnement numérique ?

L’accès nécessite un identifiant unique protégé par chiffrement SSL, garantissant la confidentialité des échanges.

Les pièces jointes PDF peuvent être indexées séparément du corps des articles, affectant parfois la recherche interne.

L’utilisation d’opérateurs avancés comme les wildcards (%) pose problème sur certaines plateformes techniques standard.

Les données de connexion apparaissent majoritairement comme « not provided », nécessitant des outils alternatifs.

- L’authentification repose sur des identifiants chiffrés via HTTPS, masquant les termes de recherche initiaux

- L’analyse des pages d’atterrissage permet de contourner partiellement l’absence de mots-clés visibles

- Google Search Console constitue l’outil alternatif privilégié pour observer les requêtes réelles des utilisateurs

- Les bases de connaissances peuvent apparaître dans les résultats via l’indexation de leurs pièces jointes uniquement

- Les recherches « for text » utilisant des wildcards ne renvoient aucun résultat dans les instances par défaut

- Les fichiers robots.txt et les balises noindex offrent des méthodes distinctes de contrôle d’indexation

- La combinaison simultanée de robots.txt et noindex est déconseillée pour éviter les blocages contradictoires

| Aspect technique | Constat factuel | Source |

|---|---|---|

| Protocole HTTPS | Masquage systématique des mots-clés organiques | Neil Patel |

| Trafic « not provided » | Représente la majorité du trafic analytique | Crazy Egg |

| Google Search Console | Solution de contournement recommandée | Whole Whale |

| Indexation KB | Contenu des pièces jointes (PDF, DOC) visible malgré absence de mots-clés dans le corps | ServiceNow |

| Recherches wildcards | Opérateurs %search-term% inefficaces par défaut | ServiceNow Support |

| Prévention indexation | Utilisation de robots.txt ou noindex possible | HubSpot |

| Analyse alternative | Étude des pages d’atterrissage pour déduire l’intention | Whole Whale |

| Recherche IA | Dysfonctionnements possibles avec certains widgets de contenu | ServiceNow Community |

Pourquoi les termes de recherche vers l’espace client apparaissent-ils comme « not provided » ?

Le chiffrement des connexions via HTTPS, généralisé par Google pour des raisons de confidentialité, affecte directement la visibilité des requêtes tapées par les utilisateurs recherchant ouest france mon compte. Les données analytiques standards affichent désormais « not provided » pour environ 90 % du trafic organique, rendant impossible l’identification précise des intentions de recherche.

L’impact du chiffrement SSL sur l’analyse du trafic

Lorsqu’un internaute clique sur un résultat de recherche depuis une session sécurisée, le navigateur n’envoie plus l’information du mot-clé utilisé au site de destination. Cette pratique, initialement limitée aux utilisateurs connectés à Google, s’est étendue à l’ensemble des recherches organiques, transformant profondément les méthodes d’analyse du comportement des abonnés numériques.

Méthodes alternatives d’analyse du trafic

Plusieurs approches permettent de pallier cette opacité. L’analyse des pages d’atterrissage offre des indices indirects sur les intentions des visiteurs. Parallèlement, Google Search Console conserve l’accès aux requêtes réelles, bien que sans les données de parcours post-clic détaillées.

L’examen des pages d’atterrissage permet de déduire les intentions des utilisateurs même lorsque les mots-clés spécifiques restent masqués. Une page de connexion recevant du trafic organique suggère généralement une recherche d’accès direct, indépendamment du terme exact utilisé.

Quels dysfonctionnements affectent les recherches d’informations sur les espaces abonnés ?

Indexation parasitaire des pièces jointes

Les systèmes de gestion de connaissances peuvent indexer le contenu des pièces jointes (PDF, documents Word) indépendamment du corps textuel principal. Une base de connaissances apparaît ainsi dans les résultats bien qu’aucun mot-clé ne soit présent dans sa description visible, créant une confusion potentielle pour l’utilisateur recherchant une procédure spécifique.

Limites des opérateurs de recherche avancée

Les recherches utilisant des wildcards comme %search-term% pour trouver des variations de texte dans les bases de connaissances ne renvoient aucun résultat dans les configurations par défaut. Cette limitation technique contraint les utilisateurs à formuler des requêtes exactes, augmentant le risque d’échec de recherche.

Certains widgets de recherche par intelligence artificielle présentent des dysfonctionnements spécifiques où le contenu textuel disponible n’est pas retrouvé malgré la présence effective des termes recherchés dans la base documentaire.

Comment empêcher l’indexation publique de son espace personnel ?

La protection des espaces clients contre l’indexation par les moteurs de recherche externes repose sur deux mécanismes principaux, dont l’utilisation simultanée est déconseillée. Le fichier robots.txt guide les robots d’indexation, tandis que la balise méta noindex agit au niveau de la page elle-même.

Il est fortement déconseillé de combiner simultanément l’utilisation de fichiers robots.txt et de balises noindex pour le même contenu. Cette pratique peut entraîner des blocages contradictoires où la page est interdite d’exploration avant que la directive noindex ne soit lue, empêchant ainsi sa suppression effective des index.

La prévention de l’apparition dans les résultats de recherche nécessite donc un choix stratégique entre ces méthodes exclusives, particulièrement critique pour les portails d’abonnés contenant des données personnelles.

Chronologie de l’opacification des données de recherche web

- 2011 : Google initie le chiffrement des recherches pour les utilisateurs connectés, débutant l’ère du « not provided » sélectif

- 2013 : Généralisation complète du masquage des mots-clés organiques via HTTPS, affectant l’ensemble des rapports analytics

- Développement des KB : Apparition des problèmes d’indexation des pièces jointes dans les bases de connaissances ServiceNow, où le contenu PDF se dissocie du corps textuel

- Limitations wildcards : Reconnaissance officielle des dysfonctionnements des recherches textuelles utilisant des opérateurs de substitution dans les instances standards

- Recommandations actuelles : Publication des guidelines concernant la non-combinaison des méthodes robots.txt et noindex pour éviter les conflits d’indexation

Certitudes et incertitudes concernant l’accès aux comptes numériques

| Information établie | Zones d’incertitude |

|---|---|

| Le chiffrement HTTPS masque systématiquement les mots-clés dans Google Analytics | Les procédures exactes de récupération de mot de passe spécifiques à l’interface Ouest-France n’ont pas pu être vérifiées |

| Google Search Console offre une alternative fiable pour visualiser les requêtes | Les spécificités techniques du moteur de recherche interne du journal restent non documentées dans les sources disponibles |

| Les pièces jointes PDF sont indexables indépendamment du texte principal | Le pourcentage exact de trafic « not provided » pour les sites de presse régionale n’est pas établi |

| L’analyse des pages d’atterrissage permet d’inférer les intentions | L’efficacité comparative des méthodes d’authentification alternatives n’a pas été mesurée |

| Les wildcards posent problème dans les recherches textuelles standards | La date exacte des dernières évolutions techniques du portail abonnés n’est pas communiquée publiquement |

| La combinaison robots.txt/noindex présente des risques documentés | Les délais réels de prise en compte des demandes de désindexation restent variables |

Contexte de la protection renforcée des données de navigation

La transition vers des protocoles de communication sécurisés répond à des impératifs de confidentialité croissants. Cette évolution, salutaire pour la protection de la vie privée des internautes, a néanmoins transformé les outils traditionnels d’analyse d’audience. Les éditeurs de presse, confrontés à cette opacité croissante, doivent développer de nouvelles méthodologies pour comprendre les parcours de leurs abonnés sans accéder aux requêtes exactes formulées.

L’absence de données précises dans les rapports standards oblige les gestionnaires de portails comme ouest france mon compte à s’appuyer davantage sur des indicateurs comportementaux indirects, tels que le temps passé sur les pages de connexion ou les taux de rebond, plutôt que sur l’intention déclarée via les termes de recherche.

Sources et fiabilité des informations techniques citées

Les mots-clés organiques sont désormais masqués dans Google Analytics pour des raisons de confidentialité via HTTPS, affectant les rapports analytiques, mais des contournements existent comme l’analyse des pages d’atterrissage ou l’utilisation de Google Search Console.

— Neil Patel, Whole Whale, Crazy Egg (études convergentes)

Les données présentées issues de ServiceNow concernent spécifiquement les dysfonctionnements de moteurs de recherche internes et d’indexation de bases de connaissances. Les limitations temporelles des sources doivent être notées : ces informations, bien que techniques et vérifiables, datent majoritairement d’avant 2026 et nécessitent une mise à jour pour les évolutions récentes des algorithmes.

Points essentiels à retenir pour sécuriser ses accès

L’accès aux espaces personnels des grandes publications régionales se caractérise désormais par une tension entre sécurité accrue et visibilité analytique réduite. Comme pour la gestion de l’EDF Espace Personnel – Accès, Création et Gestion Facile, l’utilisateur doit composer avec des systèmes où ses intentions de recherche restent privées. La vigilance porte particulièrement sur la vérification des méthodes d’indexation pour éviter l’exposition accidentelle de données personnelles via des documents attachés mal paramétrés.

Questions fréquentes sur l’accès aux comptes numériques

Que signifie exactement « not provided » dans les statistiques de connexion ?

Il s’agit d’une mention substituée aux mots-clés réels dans Google Analytics, résultant du chiffrement HTTPS des recherches Google qui masque les termes utilisés par l’internaute pour des raisons de confidentialité.

Comment retrouver les mots-clés masqués sans violer la confidentialité ?

Google Search Console conserve l’accès aux requêtes réelles. L’analyse des pages d’atterrissage permet également de déduire indirectement les intentions de recherche sans accéder aux données individuelles.

Pourquoi certains documents apparaissent-ils dans les résultats sans mots-clés visibles ?

Les pièces jointes PDF ou Word sont indexées séparément de leur conteneur. Leur texte interne est analysé par les moteurs indépendamment du corps de l’article ou de la fiche qui les héberge.

Faut-il préférer robots.txt ou noindex pour protéger un espace client ?

Ces méthodes sont mutuellement exclusives. Le choix dépend de l’objectif : robots.txt guide l’exploration, noindex contrôle l’indexation. Jamais les deux simultanément pour éviter les conflits techniques.

Les recherches avec jokers (%) fonctionnent-elles dans les bases internes ?

Non, dans les configurations standard, les wildcards type %search-term% ne renvoient aucun résultat. Les requêtes doivent utiliser des correspondances exactes ou des opérateurs spécifiques au système.

Comment contacter l’assistance Service Client Free Mobile – Contacts, horaires et astuces ou similaire ?

Pour les portails d’abonnement numérique, les méthodes de contact varient. L’exemple du service client téléphonique montre l’importance de vérifier les horaires et canaux officiels directement sur les interfaces sécurisées.

Pourquoi les recherches IA ne trouvent-elles pas certains contenus existants ?

Les widgets de recherche par intelligence artificielle présentent des dysfonctionnements connus où l’indexation du contenu ne garantit pas sa retrievabilité, particulièrement avec les opérateurs de recherche textuelle complexes.